از بین رفتن مرز واقعیت و دروغ/ هر آن چه که باید درباره دیپ فیک بدانید

مطمئناً در چند سال اخیر، به ویدیویی برخوردید که فکر میکردید واقعی است، اما کاملا جعلی بوده است؛ این جادوی تکنولوژی دیپفیک است.

در دهه ۱۹۷۰ تا ۱۹۸۰ میلادی، شرکتی با نام Memorex در حوزهی تولید نوارهای کاست فعالیت میکرد. در تمام کمپینهای تبلیغاتی این شرکت، همواره یک جملهی خاص تکرار میشد: «آیا این صدای واقعی است یا Memorex چنین کیفیتی دارد؟»

با گذشت بیش از ۴۰ سال از آن زمان، اکنون در موقعیتی مشابه قرار گرفتهایم؛ بااینتفاوت که بحث دیگر بهاندازهی کیفیت صدای ضبطشده در نوار کاستهای Memorex، پیشپاافتاده نیست؛ بلکه حالا باید مرز حقیقت و دروغ را از یکدیگر تشخیص دهیم.

بهاحتمال زیاد تاکنون بارها به ویدئوهای دیپفیک (Deepfake) برخورده باشید؛ ویدئوهایی که اساساً هیچگونه انطباقی با حقیقت ندارند، اما آنقدر به واقعیت نزدیکاند که بهسختی میتوان متوجه جعلیبودن آنها شد. از سیاستمداران معروف مثل اوباما و ترامپ گرفته تا سلبریتیها و حتی مدیران مطرح دنیای فناوری، همگی در چند سال گذشته بهنوعی با این پدیدهی حیرتآور و درعینحال، دردسرساز دستوپنجه نرم کردهاند. از عکسهای ساختگی هنرمندان مشهور بگیرید تا سخنرانیهای جعلی سیاستمداران و اظهارنظرهای طنزگونه مدیران فناوری درباره موضوعاتی نظیر حفظ حریم خصوصی، همگی نمونههایی از آماده نبودن جامعه برای پذیرش و استفادهی مناسب از نوعی تکنولوژی نسبتا نوظهور است که اتفاقا پتانسیل و کارایی آن بسیار بیشتر از آن چیزی است که تاکنون از خود نشان داده است.

راستش را بخواهید، چند وقتی است که توجه رسانهها و کاربران اینترنتی به پدیدهی «دیپفیک» در سایهی اتفاقات جدید و هیجانانگیزتری مانند مولد تصویر Dall-E و چتبات نابغهی ChatGPT کمرنگ شده است. بااینحال، تکنیک دیپفیک کماکان در فهرست تکنولوژیهای کمنظیر بشر قرار دارد و پژوهشگران بسیاری در حال بهبود آن هستند.

از سوی دیگر، شرکتهای تکنولوژی دیگری نظیر اینتل در حال توسعهی ابزارهایی هستند تا به کمک آنها بتوان ویدیو دیپفیک را تشخیص داد. برخی دیگر مانند وبسایت Kaggle نیز مسابقاتی با جوایز یک میلیون دلاری برای تشخیص ویدیوهای دیپفیک برپا میکنند تا از این طریق، خطرات این تکنولوژی و سرعت محو شدن مرز واقعیت و دروغ را کاهش دهند.

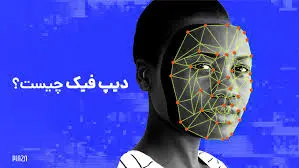

دیپفیک چیست؟

دیپفیک نام یک تکنیک نرمافزاری مبتنیبر هوشمصنوعی است که در محتوای صوتی و تصویری دست میبرد و آن را بهدلخواه تغییر میدهد؛ بنابراین نتیجهی نهایی که بهدست میآید، چیزی کاملا متفاوت از حقیقت خواهد بود. درواقع نام این تکنیک نیز بهدرستی عملکرد آن را آشکار میسازد؛ دیپفیک، ترکیبی از «یادگیری عمیق» (Deep Learning) و «جعلی» (Fake) است.

شاید برایتان عجیب باشد؛ اما کارگردانان سینما یکی از قدیمیترین استفادهکنندگان از این فناوری بودهاند. سر پیتر کوشینگ، بازیگر انگلیسی که نقش «گرند ماف تارکین» را تا پیشاز مرگش در سال ۱۹۹۴ در مجموعه فیلمهای جنگ ستارگان بازی میکرد، باری دیگر در فیلم «روگ وان: داستانی از جنگ ستارگان» محصول سال ۲۰۱۶، ظاهر شد. در همین فیلم با استفاده از تکنیک مشابه، شخصیت «پرنسس لیا» هم بازسازی و جوان شد. در نمونهای دیگر، ستارهی فیلم «سریع و خشن»، پاول واکر که پیش از تکمیل فیلمبرداری هفتمین قسمت از این سری در تصادف رانندگی درگذشت، بهلطف دیپفیک، کماکان در این فیلم به ایفای نقش پرداخت.

درواقع فناوری دیپفیک برای ایجاد محتوای صوتی و تصویری متقاعدکننده و درعینحال غیرواقعی ساخته شده است. برنامههای ویرایش تصویر نظیر فتوشاپ، سالها است کاری مشابه را ازطریق دستکاری تصاویر انجام میدهند؛ اما چیزی که اکنون با آن روبهرو هستیم، مبحثی کاملاً متفاوت، پیچیدهتر و فریبندهتر از دستکاری تصویر در فتوشاپ است.

از آنجایی که دیپفیک یک تکنیک مبتنیبر هوش مصنوعی است، نیازی به دخالت مستقیم انسان ندارد؛ ازاینرو، هرکسی ازطریق دیپفیک میتواند ویدئویی جعلی و درعینحال واقعگرایانه درست کند. هرچه تکنیک دیپفیک پیشرفتهتر میشود، تشخیص مرز واقعیت و دروغ نیز دشوارتر خواهد شد.

دیپ فیک چگونه کار میکند؟

اصطلاح «دیپفیک» از تکنولوژی بهکار رفته در آن، یعنی «Deep Learning» به معنی یادگیری عمیق گرفته شده که نوعی هوش مصنوعی است. الگوریتمهای یادگیری عمیق که به خودشان یاد میدهند چگونه به کمک مجموعههای بزرگی از داده، به حل مسائل گوناگون بپردازند، در تکنیک دیپفیک برای برش چهرهها از یک محتوای ویدیویی و چسباندن آنها در محتوایی دیگر برای ایجاد ویدئو یا تصویری جعلی با ظاهری واقعی استفاده میشوند.

روشهای مختلفی برای ساخت دیپفیک وجود دارد، اما در رایجترین روش، از شبکههای عصبی عمیق شامل خودرمزگذارها (Autoencoders) برای بهکارگیری تکنیک تعویض چهره استفاده میشود. برای ساخت دیپفیک، ابتدا به یک ویدیو به عنوان ویدیوی پایه و اصلی نیاز دارید و بعد لازم است به مجموعهای از کلیپهای ویدیویی از شخصی که میخواهید از او دیپفیک بسازید، دسترسی داشته باشید.

ویدیوی اصلی و مجموعه کلیپها میتوانند کاملاً نامرتبط باشند؛ مثلا ویدیوی اصلی میتواند بخشی از یک فیلم هالیوودی باشد و ویدیوهای شخصی که میخواهید از او دیپفیک بسازید، میتواند کلیپهایی باشد که بهطور رندوم از یوتیوب دانلود کردهاید.

خودرمزنگار نیز ابزاری مبتنیبر هوش مصنوعی از نوع یادگیری عمیق است که وظیفهاش مطالعهی کلیپهای ویدیویی برای فهمیدن این است که شخص موردنظر از زوایا و در شرایط محیطی مختلف چگونه به نظر میرسد. این ابزار سپس با پیدا کردن ویژگیها و الگوهای مشترک، چهرهی این شخص را روی فرد حاضر در ویدیوی اصلی قرار میدهد تا دیپفیک ساخته شود.

نوع دیگری از یادگیری ماشین که در تکنیک دیپفیک به کار میرود، شبکه مولد رقابتی (GAN) نام دارد که هر گونه نقص و ایراد در دیپفیک را در چندین دور، شناسایی کرده و بهبود میبخشد تا بدینترتیب، کدبرداری از آنها برای ابزارهای تشخیص دیپفیک سختتر شود.

شبکههای مولد رقابتی نیز مانند شبکههای عصبی عمیق از روشهای بسیار محبوب و متداول ساخت دیپفیک هستند. این شبکهها با مطالعهی حجم بسیار گستردهای از داده، یاد میگیرند چگونه با دقتی چشمگیر نمونههای جعلی جدیدی تولید کنند که شبیه نسخهی واقعی به نظر برسد.

البته این روزها، با دانلود اپلیکیشن و نرمافزارهای بعضا رایگان، هر کسی میتواند بهراحتی و در عرض چند ثانیه، ویدیوی دیپفیک تولید کند، بیآنکه نیاز باشد از هوش مصنوعی و شبکههای عصبی سر در بیاورد؛ اما واضح است که ویدیوهای تولید شده با این ابزارها، کیفیت بالایی ندارند و دیپفیک بودن آنها کاملا مشخص است.

تاریخچه دیپ فیک

شاید فکر کنید دیپفیک تکنولوژی جدیدی است؛ اما زمینهی توسعهی آن بسیار قدیمیتر از چیزی است که اکثر مردم تصور میکنند و در گرو اختراعات دیگری مانند نرمافزارهای کامپیوتری، الگوریتمها و هوش مصنوعی است. بههمینخاطر، تعیین دقیق لحظهای که این تکنولوژی برای اولین بار شکل گرفت، بسیار دشوار است. بااینوجود، ما در اینجا سعی میکنیم شما را تاحدی با تاریخچهی دیپفیک آشنا کنیم.

تاریخ ظهور محتوای ویدیویی و تصویری که به منظور فریب بیننده، دستکاری شدهاند، به زمانهای بسیار دور برمیگردد؛ اما ویدیوهای دیپفیک به شکلی اکثرا با آن آشنا هستیم، با توسعهی هوش مصنوعی از گوشهوکنار اینترنت سر برآوردند.

ایدهی دستکاری تصویر در قرن نوزدهم و تقریبا همزمان با همهگیرتر شدن دوربین عکاسی در ذهن بشر شکل گرفت و طولی نکشید که پای دستکاری محتوای رسانهای به فرمت ویدیویی نیز کشیده شد. بااینحال، استفاده از الگوریتمهای کامپیوتری برای دستکاری محتوای ویدیویی بهطور خودکار و خب، واقعیتر، اتفاقی بهمراتب جدیدتر است؛ و مانند بسیاری از تکنولوژیهای بشر، ظهور این تکنولوژی نیز از دانشگاهها بود.

در سال ۱۹۹۷، مقالهای به قلم کریستف برگلر، میشل کاول و مالکوم اسلینی به توسعهی نرمافزاری نوآوارانه و کاملا منحصربهفرد انجامید که بهکمک آن میشد کاری را که برخی استودیوهای فیلمسازی انجام میدادند، بهطور خودکار انجام داد. این نرمافزار که در نوع خود اولین بود، Video Rewrite Program نام داشت و با استفاده از آن میشد ویدیوهای موجود از صحبت کردن افراد را دستکاری کرد؛ بدینصورت که لایهی صوتی روی ویدیوی اصلی قرار میگرفت و طوری با حرکت لبهای فرد حاضر در ویدیو همگامسازی میشد تا این طور به نظر برسد که فرد دارد دقیقا آن کلمات را به زبان میآورد.

نرمافزار Video Rewrite Program اولین نمونه از تکنولوژی «دیپفیک» بود که توانست «صدای فیک و جعلی» را روی ویدیو قرار دهد و درواقع، شخص حاضر در ویدیو را وادار به گفتن چیزی کند. هرچند تکنیک به کار رفته در این نرمافزار برای دوبلهی فیلم استفاده میشد و شاید کسی آن را دیپفیک بهشمار نیاورد، این تکنیک مبتنی بر یادگیری ماشین بود و این با تعریفی که از ویدیوی دیپفیک داریم، مطابقت دارد.

نتایجی که از مقالهی ۱۹۹۷ و بهکمک نرمافزار Video Rewrite Program بهدست آمد، ویدیوهای کوتاه اما بهطرز غافلگیرکنندهای، فریبدهنده بودند؛ خودتان قضاوت کنید:

البته تشخیص ویدیوی اصلی از فیک با توجه به چیزی که جان اف. کندی میگوید، آسان است؛ اما توسعهی این تکنولوژی در زمانی که جایزهی اسکار بهترین جلوههای ویژه به فیلم «روز استقلال» رسیده بود، واقعا جالبتوجه است.

از اهمیت نقش مقالهی ۱۹۹۷ و نرمافزار Video Rewrite Program در توسعهی تکنولوژی دیپفیک هرچه بگوییم، کم است؛ درواقع، بسیاری از افکتهای ویدیویی که امروزه در نرمافزارهای محبوبی چون Premiere Pro یا Final Cut به کار رفتهاند، از نسخهی بهبودیافتهی همان الگوریتمهایی استفاده میکنند که در این مقاله ذکر شده بود.

اوایل دههی ۲۰۰۰ که توجه حوزهی بینایی ماشین به تکنولوژی تشخیص چهره جلب شد، در دنیای دیپفیک و دستکاری ویدیو تقریبا خبری نبود. بااینحال، پیشرفتهایی که در زمینهی تشخیص چهره صورت گرفت، باعث بهبود چشمگیری در تکنیکهایی مانند ردیابی حرکت شد تا دیپفیکهای امروزی قانعکنندهتر ظاهر شوند.

در سال ۲۰۰۱، تیموتی اف. کوتس، گرت جی. ادواردز و کریستوفر جی. تیلور در مقالهای، به معرفی الگوریتمی بهنام مدل فعال ظاهر (AAM) پرداختند که در آن زمان محبوبیت زیادی پیدا کرد. به کمک این الگوریتم که تطبیق و ردیابی چهره را بهطرز قابلتوجهی بهبود میداد، میتوان از یک مدل آماری کامل برای تطبیق یک شکل با یک تصویر استفاده کرد و این گام رو به جلویی بزرگی بود.

در سال ۲۰۱۶ و ۲۰۱۷، دو مقاله مهم منتشر شد که استفاده از تکنیکی را که بعدا به دیپفیک معروف شد، با سختافزارهای در دسترس مردم ممکن میکرد. یکی از آنها پروژهی Face2Face بود که از دانشگاه فنی مونیخ سر بر آورد؛ به کمک این برنامه میتوان در لحظه، حالات چهرهی فرد در ویدیوی اصلی را بهکمک حالات صورت فرد دیگر به حرکت در آورد و ویدیوی دستکاری شده را بهصورت واقعبینانهای از نو رندر کرد.

پروژهی دوم هم Synthesizing Obama نام داشت که کار دانشجویان دانشگاه واشنگتن بود. بهاحتمال زیاد نتیجهی این پروژه را در گوشهوکنار اینترنت دیدهاید. در این پروژه، ویدئویی جعلی و با کیفیت بالا از سخنرانی باراک اوباما را میبینیم که حرکت لبهایش آنقدر خوب از آب درآمده که انگار واقعا دارد همان کلمات را به زبان میآورد.

اگرچه اهداف این دو مقاله کاملا متفاوت بودند، هر دو زمان لازم برای انجام پردازشهای یارانشی و رندر ویدیو را بهطور چشمگیری کاهش دادند و در عین حال، شباهت بین دو تصویر اصلی و فیک را بهحدی بهبود دادند که واقعی بهنظر برسد.

اما اینکه خود کلمهی «دیپفیک» از کجا آمد، نه به شرکت یا گروه پژوهشی، بلکه به یک کاربر عادی ردیت مربوط میشود که برای اولین بار استفاده از این کلمه را در سال ۲۰۱۷ در یکی از سابردیتهای این پلتفرم رایج کرد. کاربری ناشناس با نام «deepfakes» شروع به آپلود ویدیوهایی جعلی با محتوای پورنوگرافی کرد که در آن از چهرهی برخی از بازیگران مشهور آمریکایی استفاده شده بود. خود کلمه دیپفیک درواقع ترکیبی از اصطلاح «Deep Learning» (یادگیری عمیق) و «Fake» (جعلی) است و این تکنیک را طوری توصیف میکند تا برای همه قابلفهم باشد.

نمونههای اولیه دیپفیک از ابزارهایی کمک گرفته بود که چهرهی فرد موردنظر را فریمبهفریم روی ویدیوی اصلی قرار میداد؛ فرایندی که گاهی با خطا همراه بود و بهسرعت پای شخصیتهای سیاسی و مجریان تلویزیونی را هم وسط کشید. افراد مشهور راحتترین هدف برای ساخت ویدیوهای دیپفیک هستند، چراکه تصاویر آنها بهوفور در اینترنت یافت میشود و میتوان با آنها الگوریتمهای دیپفیک را آموزش داد. اینروزها ساخت ویدیوی جعلی اما واقعبینانه از افراد مشهور به شدت آسان است.

با اینحال، اگر بپرسید دیپفیک را دقیقا چه کسی اختراع کرد، بهترین جواب فردی به نام یان گودفلو (Ian Goodfellow) است که تحقیقات گستردهای در زمینهی یادگیری عمیق انجام داده است. یان که ابتدا در گوگل برین کار میکرد و سپس در سال ۲۰۱۹ به اپل پیوست، دانشمند بسیار معروفی است که در سال ۲۰۱۴، شبکه مولد رقابتی (GAN) را توسعه داد. این شبکهها که وظایف یادگیری بدون نظارت را در یادگیری ماشین انجام میدهند، ضروریترین اجزای تکنیک دیپفیک هستند و بدون آنها ساخت دیپفیک بهصورتی که امروزه میشناسیم، غیرممکن میبود.

برنامههای ساخت دیپ فیک

اگر به ساخت ویدیوهای دیپفیک علاقهمند هستید، در ادامه به معرفی چند اپلیکیشن و نرمافزار محبوب ساخت دیپفیک پرداختهایم که میتوانید از آنها استفاده کنید.

۱- وبسایت Deepfakes

با سرویس Deepfakes میتوانید ویدیوهای دیپفیک را در بدون نیاز به نصب اپلیکیشن ایجاد کنید. برای اینکه این سرویس بتواند بهکمک یادگیری عمیق، تمام جزییات پیچیدهی تصویر و ویدئویی را که آپلود کردهاید، یاد بگیرد، حداکثر به ۴ ساعت زمان نیاز دارد. تعویض چهرهها با کمک مدل آموزش دیدهی سرویس نیز ۳۰ دقیقه طول خواهید کشید. نسخهی رایگان Deepfakes، ویدیوی خروجی را تا حدود ۵ ساعت بعد آماده میکند، اما نسخهی پولی تنها یک ساعت زمان لازم دارد.

اگرچه این سرویس از پردازندههای گرافیکی قدرتمندی در فضای ابری استفاده میکند، کماکان برای رندر کردن تمام دادهها به ساعتها زمان نیاز دارد. این نشان میدهد که ساخت ویدیوی دیپفیک کار آسانی نیست و بههمین خاطر است که اپلیکیشنهایی مثل Zao که تنها در چند ثانیه، ویدیوی دیپفیک درست میکنند، اینقدر سروصدا به پا میکنند.

۲- اپلیکیشن Wombo

این یکی را احتمالا میشناسید و کلیپهایی را که با آن ایجاد شده، در گوشهوکنار اینترنت دیدهاید. Wombo اپلیکیشنی برای همگامسازی حرکات لب است که به شما اجازه میدهد تصویر خود یا اشخاص دیگر را به ویدیویی تبدیل کنید که در آن لبهایتان حرکت میکند، انگار دارید آواز میخوانید. این اپلیکیشن، ۱۵ آهنگ پیشفرض ارائه میدهد که میتوانید با تمام آنها از تصویر موردنظر خود دیپفیک بسازید.

۳- اپلیکیشن Reface

اپلیکیشن ساخت دیپفیک Reface که ابتدا با نام Doublicat شناخته میشد، به شما امکان میدهد میمهای خندهدار با فرمت گیف درست کنید. این اپلیکیشن از هوش مصنوعی Reface AI کمک میگیرد که درواقع نوعی شبکه مولد رقابتی است. برای استفاده از این اپ تنها کافی است از خودتان عکس بگیرید و بعد فایل گیف مورد نظرتان را از بین میلیونها گیفی که در اینترنت موجود است، انتخاب کنید تا در عرض چند ثانیه، اپلیکیشن Reface چهرهی شما را روی گیف قرار میدهد.

البته در نظر داشته باشید که کیفیت گیفهای ایجاد شده همیشه خوب نیست و به میزان تطابق چهره با گیف بستگی دارد.

۴- اپلیکیشن MyHeritage

یکی دیگر از اپلیکیشنهای دیپفیک که در شبکههای اجتماعی محبوبیت زیادی پیدا کرد، MyHeritage نام دارد؛ چراکه به کاربران امکان میدهد عکسهای قدیمیشان را متحرک کنند. برای استفاده از این سرویس تنها کافی است عکسی را آپلود کرده و دکمهی Animate را فشار دهید.

این اپلیکیشن در عرض چند ثانیه، یک نسخهی متحرک از تصویر شما را تحویل میدهد که در آن چهره، چشمها و دهان حرکت میکنند؛ درست شبیه عکسهای جادویی روزنامهی The Daily Prophet در دنیای هری پاتر!

۵- نرمافزار DeepFaceLab

DeepFaceLab نرمافزاری است که به شما امکان میدهد در محیط ویندوز، ویدیوهای دیپفیک باکیفیتی بسازید. این نرمافزار در درجه اول برای پژوهشگران و دانشجویان بینایی ماشین در نظر گرفته شده است. بااینحال، اگر دوست دارید از ویدیوهای دیپفیک بیشتر سر در بیاورید، میتوانید از این ابزار استفاده کنید. DeepFaceLab از یادگیری ماشین و تلفیق تصویر انسانی برای جایگزین کردن چهرهها در ویدیو استفاده میکند.

از آنجاییکه DeepFaceLab ابزار پیشرفتهای برای پژوهشگران است، رابط کاربری پیچیدهای دارد و برای استفاده از آن باید کمی مطالعه کنید. همچنین، برای رندر کردن ویدیو، به کامپیوتری با پردازنده گرافیکی مجزای قدرتمندی نیاز دارید. اگر دانشجوی بینایی ماشین هستید، DeepFaceLab میتواند ابزار فوقاعلادهای برای درک ویدیوهای دیپفیک باشد.

جالب است بدانید شرکت انویدیا نیز بهتازگی ابزاری مبتنی بر هوش مصنوعی معرفی کرده که از طریق نرمافزار تماس ویدیویی و استریم ویدیوی Broadcast آن، میتواند تماس چشمی افراد را بهصورت دیپفیک اصطلاح کند. این قابلیت که Eye Contact نام دارد و شبیه قابلیت Attention Correction فیستایم اپل است که همراه با iOS 13 در سال ۲۰۱۹ عرضه شد، بهکمک هوش مصنوعی، خط دید کاربر را مانیتور میکند و بعد ویدیوی در حال پخش را طوری دستکاری میکند تا به نظر برسد کاربر همواره در حال نگاه کردن به دوربین است.

هدف از توسعهی Eye Contact این بوده تا فردی که درحال سخنرانی است یا یک لحظه حواسش به چیزی پرت میشود، اینطور به نظر نرسد که نگاهش روی افرادی که در حال تماشای ویدیو هستند، متمرکز نیست. حالا اینکه کاربران از این قابلیت برای بهتر کردن تجربهی سخنرانی خود استفاده کنند یا وانمود کنند که حوصلهشان از شرکت در جلسه آنلاین سر نرفته، به خودشان بستگی دارد.

مثالهای ویدیویی از دیپفیک

احتمالاً اولین آشنایی بسیاری از ما با ویدئوهای دیپفیک، همان سخنرانی جعلی باراک اوباما، رئیس جمهور پیشین آمریکا بوده که از دل پروژهی Synthesizing Obama بیرون آمده است. بااینحال، در این چند سال، ویدیوهای دیپ فیک دیگری نیز در اینترنت همهگیر شدهاند.

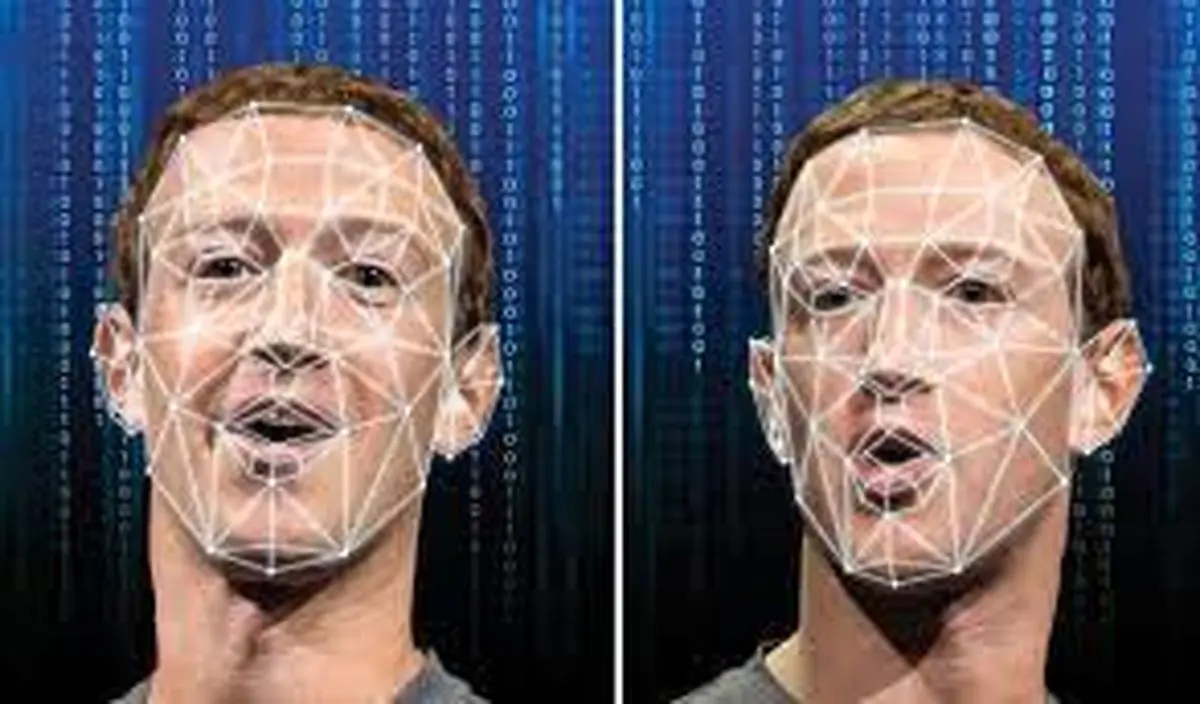

در یک نمونه از این ویدئوها، مارک زاکربرگ، مدیرعامل شرکت متا را میبینیم که با صدایی رباتگونه، جملهی «هرکسیکه دادهها را کنترل میکند، آینده را کنترل میکند» را بر زبان میآورد. در ادامه میتوانید سه نمونهی از این ویدئوها را تماشا کنید:

در ویدیوی بالا، جان اسنو، یکی از شخصیتهای محوری سریال «بازی تاج و تخت» را میبینیم که در صحنهای از فیلم، بابت تمام اشتباهاتی که این سریال در طول فصل هشتم انجام داده، از طرفداران عذرخواهی میکند. او فیلمنامه فصل ۸ را حاصل کاری ششروزه عنوان میکند و درآخر از همه میخواهد تا برای فراموشی این فصل، فیلمنامهی آن را در آتش بسوزانند. اگرچه این ویدئو نسبت به دیگر نمونههای دیپفیک از کیفیت پایینتری برخوردار است؛ اما قطعاً با پیشرفت این فناوری میتوان آیندهای را متصور شد که هرکس طبق علایق خود، دیالوگ موردنظرش را برای صحنههای مختلف فیلم درنظر بگیرد.

ویدئوی بعدی که کیفیت بسیار بالاتری دارد، بیل هیدر را در حال تقلید صدای آرنولد شوارتزینگر نشان میدهد؛ اما نکته مهم درباره این ویدئو، تغییر چهره ناگهانی وی به چهره آرنولد است. این اتفاق بهقدری طبیعی اتفاق میافتد که گویی چنین رخدادی در دنیای واقعی رخ میدهد.

یکی دیگر از واقعیترین ویدیوهای جعلی که به کمک تکنیک دیپفیک ساخته شده است، ویدیوی دیپفیک مورگان فریمن است. مطمئنم اگر به شما نگفته بودم ویدیوی بالا جعلی است، باور میکردید که خود مورگان فریمن دارد جملهی «من مورگان فریمن نیستم و آنچه میبینید، واقعی نیست.» را به زبان میآورد. این ویدیو اولینبار در کانال یوتیوب Diep Nep منتشر شد و صداگذاری فوقالعادهی آن را شخصی به نام Boet Schouwink انجام داده است.

چگونه دیپ فیک را شناسایی کنیم؟

هر تکنولوژی نوظهور همیشه با دردسرها و نگرانیهای زیادی همراه است، چراکه انسانها اکثرا ترجیح میدهند از قوهی تخیل و خلاقیتشان برای رد شدن از مرزها، شکستن قانونها و کلا فعالیتهای مجرمانه و غیراخلاقی استفاده کنند. بههمینترتیب، دربارهی تکنولوژی دیپفیک نیز این نگرانی وجود دارد که روزی به ابزار و سلاحی فوقالعاده قدرتمند برای پخش گستردهی اطلاعات نادرست، نفرتپراکنی و آزار و اذیت کاربران در شبکههای اجتماعی تبدیل شود. بهویژه حالا که ساخت ویدیوهای دیپفیک با یک کلیک ساده و در عرض چند ثانیه امکانپذیر است.

برای همین، بسیار مهم است بتوانیم ویدیوهای دیپفیک را از ویدیوهای اصلی تشخیص دهیم. فیسبوک که از زمان همهگیر شدن پدیدهی دیپفیک، بیشتر از هر پلتفرم دیگری درگیر جنبهی تاریک این تکنولوژی بوده است، با همکاری مایکروسافت، آمازون وب سرویس و ائتلاف Partnership on AI، مسابقهای با عنوان Deepfake Detection Challenge را در پلتفرم Kaggle گوگل برگزار میکند. در این مسابقه، از شرکتکنندگان خواسته میشود تا با الگوریتمهایی که خودشان توسعه دادند، روی مجموعهی بزرگی شامل ۱۰۰ هزار ویدیوی دیپفیک که توسط فیسبوک ساخته شده، کار کنند و تشخیص دهند کدام ویدیو فیک است. در یک دوره از این مسابقات، بیش از ۲ هزار نفر شرکت کردند و بیش از ۳۵ هزار مدل تشخیص دیپفیک معرفی شد.

بهترین مدلی که در این مسابقه انتخاب شد، در بیش از ۸۲ درصد موارد میتوانست بهدرستی ویدیوی دیپفیک را تشخیص دهد. اما زمانی که این مدل روی ویدیوهای تابهحال دیده نشده، تست میشد، درصد تشخیص آن به ۶۵ کاهش پیدا میکرد.

درکل، تشخیص دیپفیک بهکمک هوش مصنوعی شبیه موشوگربه بازی است؛ چراکه الگوریتمهای ساخت دیپفیک میتوانند خود را با مدل تشخیص دیپفیک آموزش دهند و یاد بگیرند چطور از الگوریتمهای تشخیص این مدل فرار کنند.

شرکت اینتل نیز ابزاری بهنام FakeCatcher توسعه داده که مدعی است میتواند در لحظه «با بررسی جریان خون در پیکسلهای ویدیو»، فیکدیپ بودن آن را تشخیص دهد!

اما آیا راهی وجود دارد تا کاربران معمولی مثل ما بتوانند بدون استفاده از الگوریتم، ویدیوی واقعی را از دیپفیک تشخیص دهند؟ گروهی از پژوهشگران دانشگاه MIT برای این کار، وبسایت Detect Fakes را راهاندازی کردهاند تا کاربران بتوانند قدرتشان را در تشخیص دیپفیک محک بزنند.

بهگفتهی این پژوهشگران، علائم بسیار جزیی در ویدیوهای دیپفیک وجود دارد که نشان میدهد توسط الگوریتمها دستکاری شدهاند. آنها توصیه میکنند برای تشخیص دیپفیک، به نکات زیر توجه کنیم:

- به چهره توجه کنید. دستکاریهای حرفهای دیپفیک معمولا روی تغییرات چهره متمرکز هستند.

- به گونهها و پیشانی توجه کنید. آیا پوست بیشازاندازه صاف یا پرچینوچروک است؟ آیا چروک پوست با پیری چشمها و موها همخوانی دارد؟

- به چشمها و ابروها توجه کنید. آیا سایهها در نقاطی ظاهر میشوند که انتظار دارید؟

- به عینک توجه کنید. آیا بازتاب نور از آن مشخص است؟ آیا نور بازتابشده بیش از حد زیاد است؟ آیا زاویه بازتاب نور با حرکت فرد، تغییر میکند؟ دیپفیک گاهی نمیتواند بهدرستی نور طبیعی را نمایش دهد.

- به موهای صورت یا نبود آنها توجه کنید. آیا موی صورت واقعی بهنظر میرسد؟ دیپفیک گاهی سبیل، خط ریش یا خود ریش را حذف یا اضافه میکند. گاهی نیز نمیتواند تغییرات موهای صورت را بهطور طبیعی نشان دهد.

- به خالهای صورت توجه کنید. آیا واقعی بهنظر میرسند؟

- به پلک زدنها توجه کنید. آیا فرد به اندازه کافی یا بیش از حد پلک میزند؟

- به حرکات لب توجه کنید. برخی از دیپفیکها از نوع همگامسازی حرکات لب هستند. آیا حرکات لب طبیعی بهنظر میرسد؟

این هشت سوال برای کمک به تشخیص ویدیوهای دیپفیک در نظر گرفته شدهاند. تشخیص دیپفیکهای باکیفیت آسان نیست، اما با تمرین میتوان به درکی نسبی برای تشخیص ویدیوی واقعی از جعلی دست پیدا کرد. شما میتوانید برای تمرین از کلکسیون کلیپهای دیپفیک Detect Fakes استفاده کنید.

برای ورود به کانال تلگرام فرتاک نیوز کلیک کنید.